千葉工大、低消費電力型深層学習用回路を高性能化する「RC-Spike」を考案

2022年11月25日09時46分 / 提供:マイナビニュース![]()

●

千葉工業大学(千葉工大)は11月24日、脳の数理モデルであるスパイキングニューラルネットワーク(SNN)を用いることで、深層学習の超低消費電力ハードウェアであるアナログ演算回路「In-memory computing(IMC)回路」を高性能化する仕組み「RC-Spike」を考案し、数値シミュレーションでその効果を実証することに成功したと発表した。

同成果は、千葉工大数理工学研究センターの酒見悠介上席研究員、九州大学大学院 総合理工学研究院の森野佳生准教授、九州工業大学大学院 生命体工学研究科の森江隆特任教授・名誉教授、NEC デジタルテクノロジー 開発研究所の細見岳生主幹研究員、東京大学の合原一幸特別教授・名誉教授(東大 国際高等研究所 ニューロインテリジェンス国際研究機構副機構長/千葉工大 数理工学研究センター主席研究員(嘱託)兼任)らの共同研究チームによるもの。詳細は、IEEE主催の回路とシステムに関する国際学会「ISCAS 2022」にて発表された。

実社会で深層学習を運用するにあたっては、認識性能などのアルゴリズム的な性能だけでなく、物理的制約を考慮する必要があり、中でも消費電力は重要な要素の1つとされている。深層学習は一般的に消費電力が大きいため、バッテリー容量が限られる小型デバイス上での駆動が困難とされることから、消費電力の低減が現在のAI研究の重要課題の1つとなっている。

消費電力を低減する最も直接的な方法の1つに、専用ハードウェアを作製するというものがある。数あるハードウェア方式の中で、特に電力効率に優れるのがIMC回路で、その原理は単純で、抵抗に流れる電流を足し合わすことで、深層学習のコアの演算である積和演算を行うというものとなっている。

IMC回路はこれまで、「既存のアルゴリズムをハードウェアにマッピングする」という、一般的なトップダウン的発想のもと開発が進められてきたという。そこで研究チームは今回、IMC回路のさらなる高性能化を目指し、脳のモデルであるSNNを応用することにしたとする。

SNNを回路化し、知能システムを構築する研究「ニューロモルフィックエンジニアリング」は、“回路をニューロンと見なし、それらをつないでネットワークを構築した上で学習させる”というボトムアップ的な発想に基づいたものであり、今回の研究では、このボトムアップ的な発想をもとに、IMC回路の再構成が目指された。

●

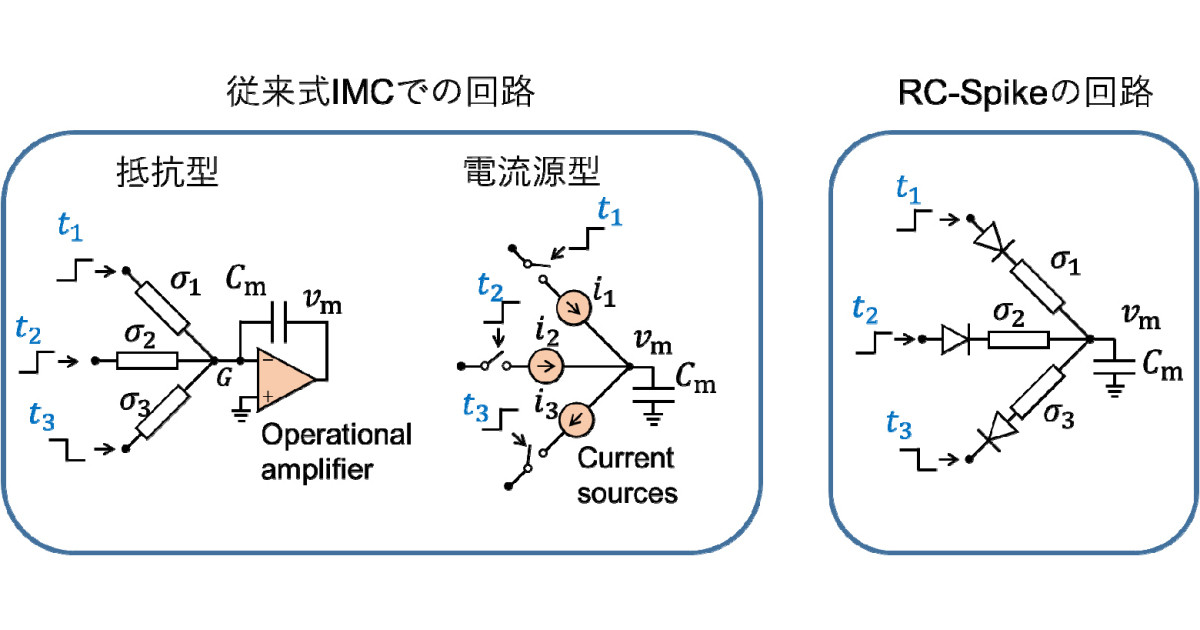

その再構成の内容は、IMC回路の構成要素(ニューロン)を単純化し、それをもとにネットワークを構築するというもので、同構成はRC-Spikeと命名された。RC-Spikeでは、従来式に見られるオペアンプや電流源のようなアクティブデバイスが取り除かれており、それにより電力効率の向上や回路面積の縮小が可能になるとする。

従来式のIMC回路では、キャパシタ電圧の時間発展は区分線形的であり、ニューロンの出力は積和演算と同等となる。IMC回路は、この性質により深層学習の演算が可能になる。

それに対してRC-Spikeでは、時間発展が指数関数的減衰の特性を持ち、出力も積和演算とは異なる。これは、キャパシタに流れ込む電流が、キャパシタの電圧に依存してしまう特性(抵抗結合効果)によるものであり、これによりRC-Spikeは、一般的な深層学習をそのまま演算することはできないという。そこでRC-SpikeをSNNと見なし、SNNの学習アルゴリズムを導出することでこの問題を解決することにしたとする。

標準的ベンチマークであるMNISTとFashion-MNISTを用いて、隠れ層が二層あるRC-SpikeのSNNの学習が行われた。RC-Spikeは、駆動電圧に相当するパラメータVsynによって、動作モードを連続的に変化させることが可能で、Vsynが小さいほど電力効率が向上し、動作がSNN的(抵抗結合効果が大きい)になる。

またRC-Spikeは、抵抗結合効果が強くなる領域(Vsyn~1)においても、一般的な深層学習と同程度の性能を維持することが実現されていることから、これらの結果から、RC-Spikeによって、認識性能を損なわずに、IMC回路を簡略化し電力効率を高めることが可能であるといえるとしている。

なお、今回の研究により、ボトムアップ的アプローチは実用上の大きな利点があることが示されたほか、SNNの新たな活用方法を示したという点も重要だと研究チームでは説明しており、今後は、より詳細なアナログ回路の特性を取り込んだアルゴリズムの開発や、回路試作などを通して、重要社会課題であるAIの電力問題に取り組んでいくとしている。

関連記事

- 東大、低費電力回路向け「スパイキングニューラルネットワークモデル」を開発

- 先端ロジックのスケーリング継続には新しいイノベーションが必要

- Intel、1億ニューロンを組み込んだ脳型システム「Pohoiki Springs」を発表

- 3次元実装は日本で研究 - IBMが注力する脳型コンピュータチップ開発(前編)

- 理研など、スキルミオンを用いた「物理リザバー素子」で画像認識に成功